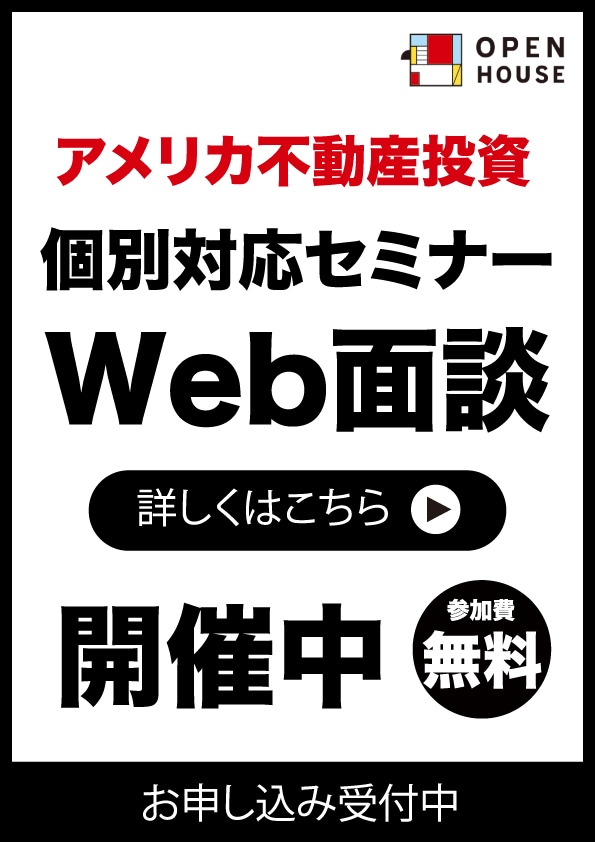

\参加無料/

【オープンハウスのアメリカ不動産投資セミナー】

OpenAI、政治活動やロビー活動への利用を制限

2024年1月15日、OpenAIは同社Webサイト上に「How OpenAI is approaching 2024 worldwide elections:OpenAIは2024年の世界選挙にどう臨むか」と題したブログ記事を公開しました。

記事内では、選挙に関連するいくつかの分野において、OpenAIの技術を利用した製品を開発することを許可しないとするポリシー改訂が紹介されています。利用が許可されない分野の具体例として、「政治活動やロビー活動を目的としたアプリケーション」「特定の人物や機関になりすましたチャットボット」「投票を妨げる(投票意欲を削ぐ)アプリケーション」などが挙げられています。

ブログ冒頭では、このポリシー改訂は、OpenAIがかねてより掲げてきた、「人々が同社ツールを安全かつ責任を持って使用する」という目標に沿ったものであることが説明されています。

過去の選挙戦で見られた、AI悪用による情報操作

近年の選挙戦において、AIが悪用される事例が増えています。動画の中の人物の顔や声、発言内容をAIによって巧妙に差し替える「ディープフェイク」によって失言を捏造された政治家は少なくありません。また、SNS上に特定の意見を大量に発信することで世論誘導する手法は古くからありますが、AIチャットボットを用いれば、より安価に、より自然な工作が可能になってしまいます。

いよいよ今年11月に行われる米国大統領選において、上記のような不正行為が多発してしまえば、AIそのものへの不信感が拭い去れないものになってしまうかもしれません。OpenAIとしては、そのような状況に陥ることを避けるためにも、AI生成コンテンツの透明性を守ることは最重要課題の1つです。

ポリシー改訂にともない、ユーザーからの違反通報の受け入れ態勢も整えることが同時発表されています。OpenAIは、悪意ある情報操作を撲滅できるのでしょうか?